Das ist hier die Frage.

Falsche Informationen durch Mensch und KI. Wie gehen wir mit dieser Herausforderung um?

Wem ist es noch nicht passiert? Da liest man gerade einen Post auf Social Media und spürt in sich die Aufregung aufsteigen.

Dabei haben wir in dem Moment noch nicht einmal realisiert, dass die Info, die schon in unserer Gefühlswelt angekommen ist, vielleicht gar nicht stimmen könnte.

In diesem Campushunter-Magazin liegt der Fokus auf KI.

Was für unglaubliche Möglichkeiten uns diese künstliche Intelligenz beschert: Systeme und Algorithmen, die in der Lage sind, Aufgaben zu erledigen, die normalerweise menschliche Intelligenz erfordern. Die immer besser werden im Lernen, in der Problemlösung, Wahrnehmung, Sprachverarbeitung und Entscheidungsfindung. Von der Diagnoseunterstützung im Gesundheitsbereich über die Betrugserkennung im Finanzwesen bis hin zur Nutzung von autonomen Fahrzeugen: KI können wir für unsere Zukunft sehr erfolgsbringend nutzen – solange wir in der Lage sind, mit KI umzugehen –, in der Anwendung als auch als Rezipient.

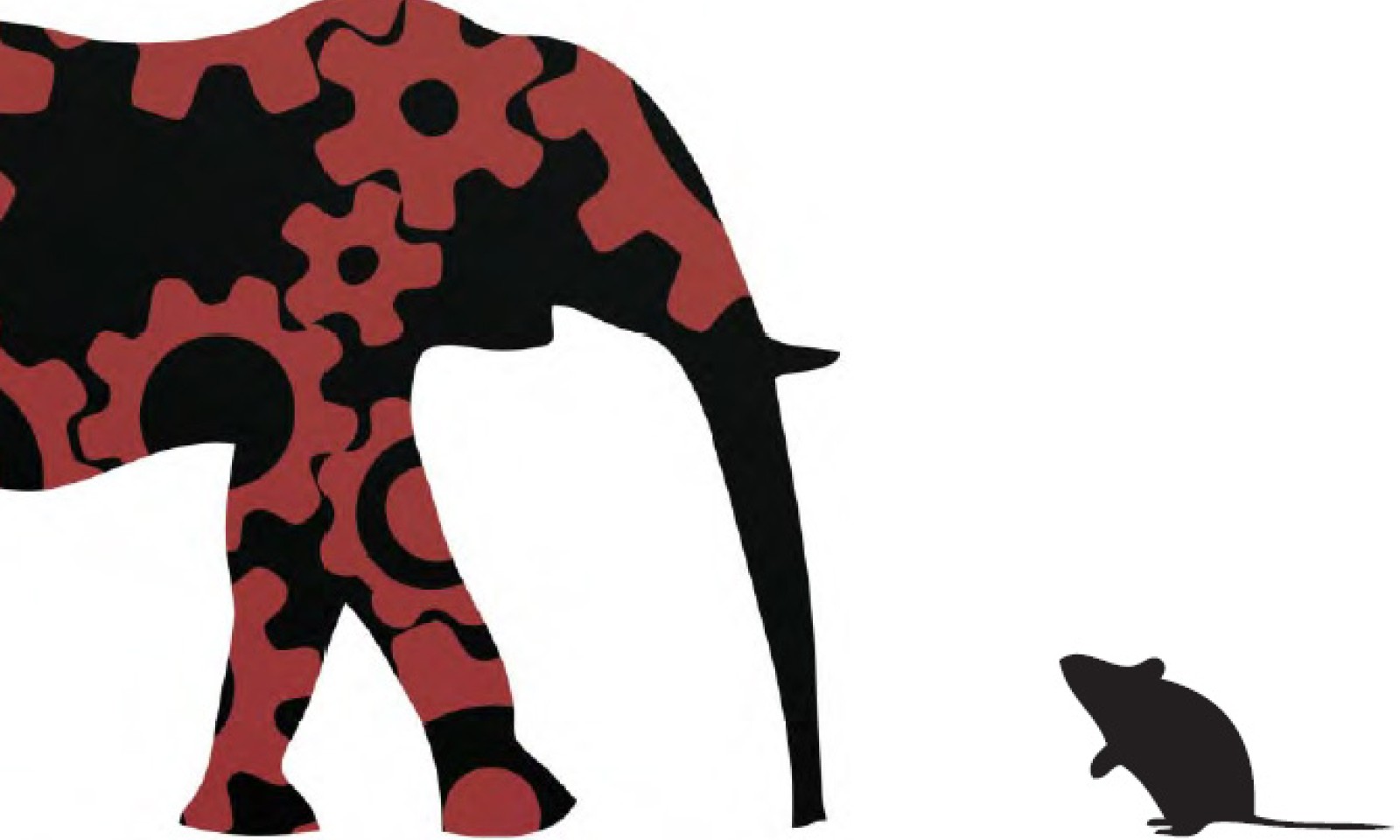

Denn jede geniale Entwicklung birgt auch Potenzial, sie für negative Absichten zu missbrauchen. Der Missbrauch liegt aber nicht in der KI, sondern erfolgt durch den Faktor Mensch, der sie steuert. Hier möchte ich nur auf einen kleinen Teil der Missbrauchsmöglichkeiten eingehen, die aber eine sehr große Wirkung haben können: Falschinformationen.

Zum Beispiel in Form von Deepfakes. Der Begriff setzt sich aus "deep learning" (einer Form des maschinellen Lernens) und "fake" (Fälschung) zusammen.

Der Begriff "Deepfake" wurde erstmals 2017 populär, als ein Benutzer im Internet, der sich "deepfakes" nannte, eine Software entwickelte, die es ermöglichte, Gesichter in Videos mithilfe von Deep-Learning-Techniken zu manipulieren, d.h., es werden Algorithmen trainiert, um Gesichter oder Stimmen zu analysieren und diese dann auf andere Personen zu übertragen. Deepfakes können im positiven Sinne sowohl für unterhaltsame Zwecke, wie in Filmen oder Memes, als auch für schädliche Zwecke eingesetzt werden, bspw. zur Verbreitung von Fehlinformationen, zur Rufschädigung oder zur Erstellung von nicht einvernehmlichen pornografischen Inhalten.

Berühmt wurde 2018 das Deepfake-Experiment mit Barack Obama. Das Video wurde von der Forschungsgruppe "BuzzFeed" in Zusammenarbeit mit dem Filmemacher Jordan Peele produziert. Es war Teil eines Projekts, das darauf abzielte, das Bewusstsein für die Gefahren von Deepfakes und die potenziellen Auswirkungen auf die Gesellschaft zu schärfen. In dem Video wurden Barack Obama Worte in den Mund gelegt, die er niemals gesagt hat – in Perfektion und in einem glaubwürdigen Setting.

Neben Deepfakes gibt es auch noch andere Wege durch KI, Informationen zu verändern – zum Beispiel:

- über Algorithmen, die Inhalte auf sozialen Medien aussteuern und somit falsche Informationen schneller verbreiten als korrekte Informationen.

- durch automatisierte Nachrichtenartikel, die von einigen Nachrichtenorganisationen durch KI generiert werden. Wenn diese Systeme nicht richtig konfiguriert sind oder auf fehlerhaften Daten basieren, können sie irreführende Informationen verbreiten.

- durch KI-gestützte Chatbots, die manchmal falsche Informationen bereitstellen können, wenn sie auf ungenauen Daten trainiert wurden oder nicht über aktuelle Informationen verfügen.

- durch Manipulation von Suchergebnissen, wenn z. B. KI-Algorithmen in Suchmaschinen bestimmte Informationen bevorzugt anzeigen.

Neben der Steuerung durch KI, kann auch das Teilen der Informationen über Dritte den Effekt verstärken: Die teilende Person prüft nicht zwingend die Richtigkeit der Information und irgendwann ist für andere User die Quelle nicht mehr ersichtlich. Das ist die eine Seite.

Während wir vermutlich an der Vielfalt der Verbreitung nicht viel ändern können, so können wir auf unseren Umgang mit Informationen achten, indem wir beispielsweise

- die Quelle eines Beitrags identifizieren und ihre Glaubwürdigkeit überprüfen.

- zu Informationen (innerlich) Fragen stellen: Wer hat sie bereitgestellt? Warum wurde sie veröffentlicht? Welche Absicht könnte dahinterstecken?

- auf das Veröffentlichungsdatum achten. Ist die Information aktuell oder veraltet?

- überprüfen, ob hier Meinungen verbreitet werden oder wirklich über Fakten geschrieben wird. Dazu gibt es Faktenchecker, Initiativen und Organisationen, die Fakenews aufdecken, wie z.B. Mimikama, APA-Faktencheck, dpa-Faktencheck, Faktenfuchs oder Volksverpetzer. Quellenvergleiche schaden bei brisanten Meldungen sicher auch nicht.

- bei echtem Interesse an einem Thema Hintergrundrecherche betreiben: Dazu gehört auch, das Thema von unterschiedlichen Seiten zu beleuchten.

- unser Bewusstsein dafür schärfen, dass die Nachricht für die Sendenden eindeutig ist, wir aber als Empfangende einen großen Interpretationsspielraum haben. Dazu kommt, dass wir dazu neigen, unsere eigenen Vorurteile und Glaubenssätze zu Themen zu haben, und diese gerne mit Meinungen und Fakten füttern, die wir mögen.

- an die Schulzeit erinnern: Wie erkennt man echte Argumente? Wie erörtert man? Stimmen die Schlussfolgerungen?

- mit anderen Menschen in Diskussion gehen, um mehr zu erfahren und verschiedene Perspektiven zu hören – gerade, wenn wir nicht sicher sind, ob eine Info stimmt oder nicht.

- das wohl Naheliegendste tun: Medienkompetenz entwickeln. Es gibt immer wieder Kurse zu KI und Tools, Social Media etc. auch an örtlichen Volkshochschulen. Hier kann man auch evtl. etwas über digitale Werkzeuge zur Analyse von Inhalten (z.B. Bild- und Videoverifikation) erlernen.

- uns gerade in Zeiten des „Doomscrollings“ ZEIT nehmen, um uns mit Infos auseinander zu setzen.

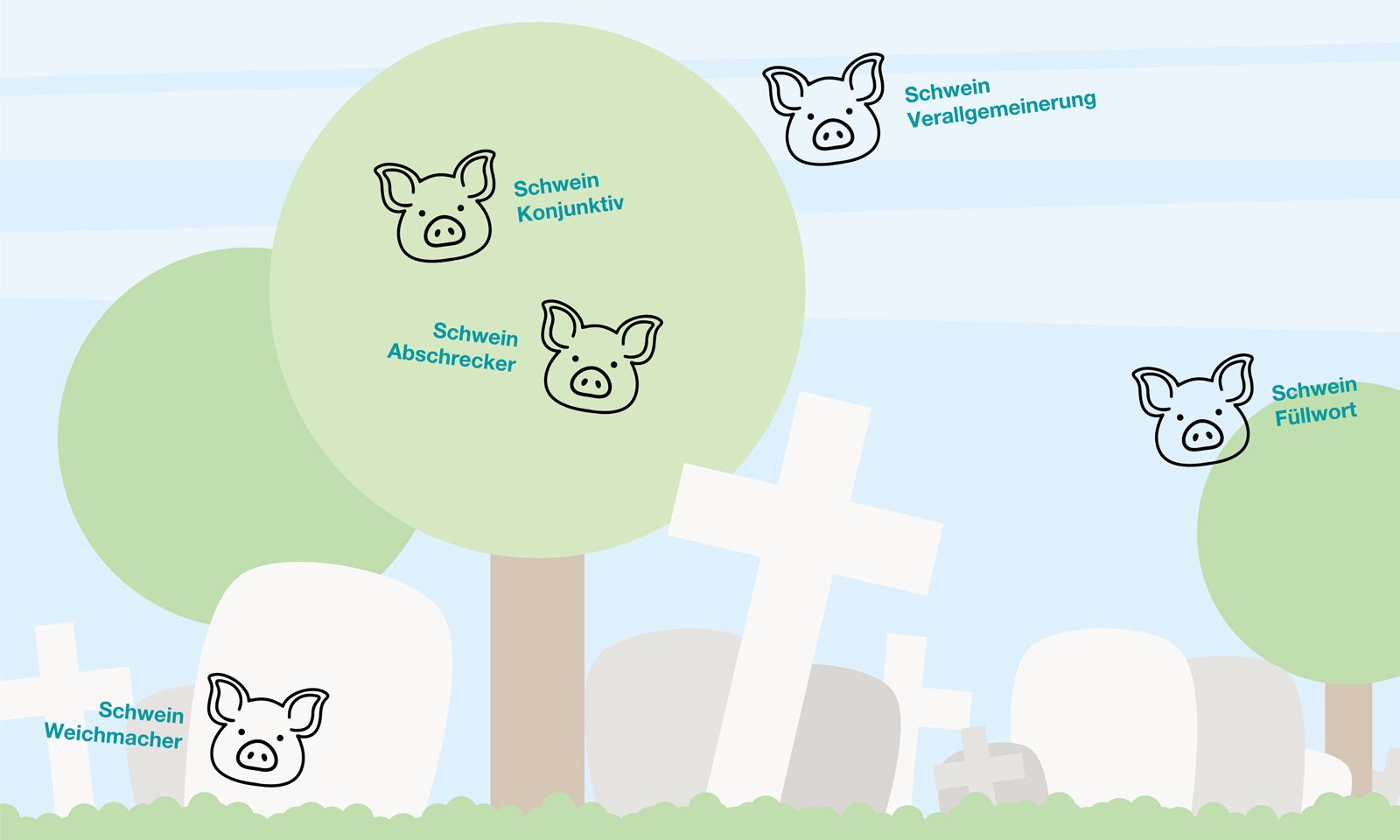

- im ersten Moment sachlich bleiben und versuchen, analytisch mit Inhalten umzugehen. Zum Beispiel können wir einen Blick auf den Schreibstil des Beitrags werfen: Seriöse Berichterstattung ist in der Regel sachlich und objektiv, während unseriöse Inhalte oft reißerisch oder emotional gefärbt sind.

Es ist unsere Aufgabe, bei jeder Veränderung mitzulernen: Es ist ein Prozess, sich mit den neuen Technologien auseinander zu setzen, zumal wir merken, schon das Verwechseln von Fakten und Meinungen, was überhaupt nicht der KI geschuldet sein muss, kann ganze Gruppen spalten.

Unsere eigene Urteilsfähigkeit, Medien- und Kommunikationskompetenz ermöglichen es uns, KI im besten Sinne zu nutzen und uns von Falschinformationen abzugrenzen.